medical image & AI

Pattern recognition and Machine learning - Bayesian decision theory(3) 본문

Pattern recognition and Machine learning - Bayesian decision theory(3)

hyunwooLee 2020. 6. 20. 18:03- review

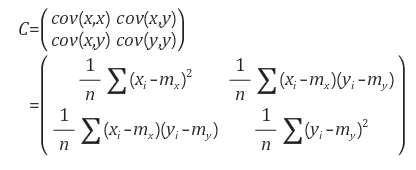

* covariance matrix에 대해서 feature가 2차원이라고 예를 들었을 때에 이 matrix의 차원은 2x2가 된다.

* 이때, 1행1열과 2행2열은 각 feature 자신의 공분산으로 생각될 수 있고, 1행2열, 2행1열은 각 feature가 서로 얼마만큼 의 상관관계를 가지고 있는지에대한 값이다.

- Multivariate [n-D] normal density as a class-conditional pdf

* 각 class에 대한 조건부확률 가우시안 분포이다.

* 먼저 2번째 그림을 보면 알 수 있듯이, C22가 C11보다 더 넓게 분포를 하고있다. 따라서 C22 값이 C11값보다 더 크다는 것을 알 수 있다. 하지만 이때 1행2열과 2행1열은 0의 값이므로 두 feature사이의 상관관계는 없다고 생각할 수 있다.

* 그와는 반대로 3번째 그림에서는 둘의 상관관계가 있고, 분포그림에서도 알 수 있듯이 조금 기울어짐으로써 둘사이에 +상관관계가 있다는 것을 알 수있다.

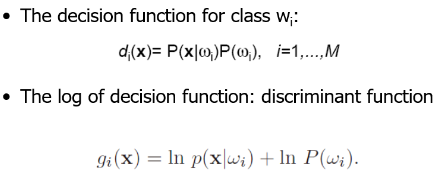

- Discriminant functions for the normal density

* 각 class에 대한 decision function은 위와 같이 나타낼 수 있고, 아래와같이 log를 씌움으로써 "discriminant fucntion"이 되는 것이고 이는 classification 할때의 계산을 더욱 단조롭게 만들 수 있다.

* discriminant function에 위의 가우시안분포 함수를 대입하면 아래와 같은 식이 만들어진다.

* 위의 식을 볼때, function of x라고 써져있는 부분 이외에 뒷부분들은 모두 상수가 된다는 것을 알 수 있다.

* 또한 우리가 class마다 비교를 할 때에 d/2ln2pi 이 부분은 모든 class가 같기 때문에 생략시켜도 무방하다.

* 이때, function of x 안에 있는 수식은, x와 m 사이의 "mahalanobis distance" 이 된다.

* Mahalanobis distance는 어떠한 확률분포상에서의 거리차이를 의미한다. 아래 그림이 그 설명을 하고있다.

* 여기에서, 같은 빨간색 등고선상에 있는 점들은 m에서부터의 mahalanobis distance가 같음을 알 수있다. 다시말해 위의 function of x 값이 같다는 의미가 된다. 이는 우리가 일반적으로 쓰는 distance 개념인 유클리디안 거리와는 차별적으로 생각하여야 한다.

- Decision surface for two classes

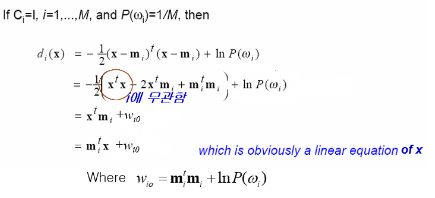

* 이제 실제로 두 class 사이의 decision surface 계산을 하여보자.

* decision surface는 두 class 공간이 서로 맞닿는 부분이므로 두 discriminant function을 뺐을 때에 0이 나오는 것으로 계산될 수 있다.

* 최종적으로 놓고보면, x에 dependent한 부분과 그렇지 않은 부분들로 나뉘는 것을 확인할 수 있다.

* 밑의 식 전개가 가지고있는 의미는 우리가 만든 discriminant function은 x대한 linear equation으로 나타내어질 수 있다는 점이다. (covariance matrix가 단위행렬로 나타내어질 때에)

* 여기에서 알 수 있는 것은 어떠한 데이터가 2차원일 때에는 그에 대한 decision boundary가 선으로 나타내어질 수 있고 1차원일 때에는 점으로 나타내어질 수 있다는 것이다.

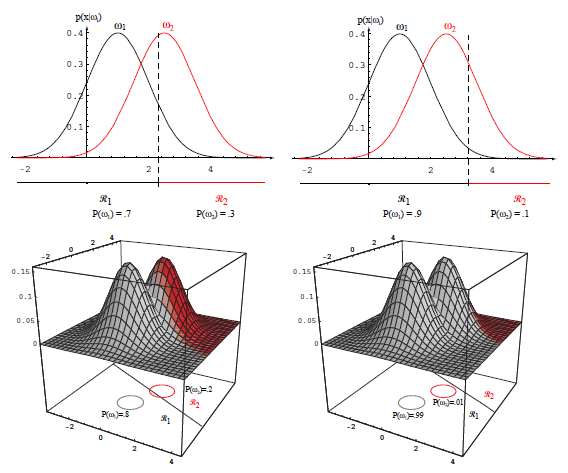

* Priori probability도 decision boundary에 영향을 미친다. 밑의 그림을 보면 알 수 있다. 만약 두 class에 대한 priori probability가 서로 다르다면 decision boundary는 gaussian 분포의 mean부분에 있지 않고 다른쪽으로 치중되어 있을 것이다.

* 또한 각 class에 대한 covariance matrix가 diagonal이 아닌 "임의의" matrix라고 가정하고 x에 대한 식으로 정리하였을 때에도 x에 대한 linear equation이 완성된다.

* covariance가 diagonal하든, arbitrary하든 decision boundary는 x에 대한 linear equation이 된다는 것을 알 수 있다.